5 ความเข้าใจผิดในการนำ AI ไปใช้งานในภาคธุรกิจ

เนื่องจากในปัจจุบันความนิยมของเทคโนโลยีปัญญาประดิษฐ์เพิ่มสูงขึ้นอย่างต่อเนื่อง ทำให้ภาคธุรกิจต้องการนำเทคโนโลยีนี้เข้ามาใช้ด้วยหลากหลายเหตุผล เช่น เพื่อสร้างความแตกต่างในสินค้าและบริการ การหา insight เพื่อตอบโจทย์ให้ลูกค้าให้ดีขึ้น หรือ เพื่อลดค่าใช้จ่ายด้านเวลาและแรงงาน แต่การใช้เทคโนโลยีไม่ถูกวิธีอาจทำให้สิ่งที่คาดหวังเหล่านั้นไม่ประสบความสำเร็จ โดยในบทความนี้จะกล่าวถึง 5 ความเข้าใจผิดในการนำ AI ไปใช้งานในภาคธุรกิจ

1. AI แก้ปัญหาแทนคนได้ทุกอย่าง

AI ที่อยู่ในสภาพพร้อมใช้กันอยู่ในปัจจุบันนี้ เป็นเพียง AI เฉพาะด้าน ที่ทำบางสิ่งบางอย่างได้ดีใกล้เคียงหรือดีกว่าคนเท่านั้น เช่น สามารถจำหน้าคนได้ เข้าใจความหมายของประโยคสั้น ๆ ได้ แยกแยะได้ว่าภาพไหนเป็นรถ คน หรือ จักรยาน เป็นต้น

การจัดการ scenario ที่หลากหลาย ซึ่งมาจากหลาย domain ไม่ใช่สิ่งที่ AI เหล่านี้ทำได้ดี (General Artificial Intelligence is still a long way away) นอกจากนี้ AI เหล่านี้เรียนรู้ (trained) มาจาก data set จำนวนหนึ่ง ซึ่งสามารถแก้ปัญหาได้เฉพาะสิ่งที่ได้เรียนรู้มาจาก data set นั้น ๆ เท่านั้น ซึ่งการแก้ปัญหาเฉพาะหน้าเมื่อเจอกับสิ่งที่ไม่เคยเจอมาก่อน ยังต้องอาศัยมนุษย์ในจัดการอยู่

ดังนั้นหากต้องการใช้ AI ในกระบวนการธุรกิจ ผู้ใช้จึงจำเป็นต้องมีความเข้าใจในขอบเขตความสามารถของ AI และ ความคาดหวังที่เหมาะสมตามความเป็นจริง จึงจะสามารถนำไปใช้ในลักษณะงานที่จะทำให้เกิดประโยชน์สูงสุดได้

2. AI ทำงานได้ดีเท่าคน

ข้อได้เปรียบของ AI ที่เหนือกว่าคน มีหลากหลายประการ เช่น ไม่มีอารมณ์ความรู้สึก จึงไม่มีทางควบคุมอารมณ์ไม่ได้แล้วพูดจาไม่ดีกับลูกค้า AI ไม่ต้องการการพักผ่อน ลาหยุด หรือ ลาป่วย เนื่องจากไม่มีความรู้สึกเหนื่อย ง่วง ขี้เกียจ หรือ ขาดสมาธิ นอกจากนี้ยังสามารถทำงานได้ตลอด 24 ชั่วโมง (อาจจะ crash บ้าง แต่เป็น 0.0001% ของคน “crash”) นอกจากนี้ AI มีข้อได้เปรียบด้านความเร็วที่สูงกว่าอย่างชัดเจน โดยอาจจะสามารถลดเวลาได้จำนวนมหาศาลในระดับเป็น 10 เท่า เมื่อเทียบกับการใช้คนทำ

หาก AI ทำงานผิด นั่นเป็นเพราะว่ามันไม่เคยเห็นสิ่งนั้นมาก่อน หรือ อาจจะเจอกับกรณียกเว้น แต่ในความเป็นจริงแล้ว เช่นเดียวกันกับที่มนุษย์ก็สามารถทำงานผิดพลาดได้ การนำ AI มาใช้จึงต้องตระหนักเรื่องนี้อยู่เสมอ

ทั้งนี้ การนำ AI มาใช้อย่างถูกต้อง อาจจะต้องทำควบคู่กันไปในหลากหลายวิธี ตัวอย่างเช่น

- ให้คนคอยตรวจเช็คและแก้ไข แต่วาง process ให้ตรวจงาน AI ได้ง่าย ๆ

การแสดงผลจาก AI จะต้องอ่านง่าย มีปุ่มให้คลิกเพียงไม่กี่ปุ่ม สามารถ edit คำตอบของ AI ได้เอง และ มีการแสดงค่าความมั่นใจของ AI เป็น score หรือ color-code เพื่อ highlight ส่วนที่คนควรจะเข้าไปดู

อย่างไรก็ตาม แม้ว่า AI ทุกตัวนั้นจะมีค่า confidence score มาด้วยเสมอ ซึ่งในการทำนายทุกครั้ง เราอาจสามารถใช้เป็นตัวบ่งบอกความมั่นใจของโมเด็ลสำหรับการทำนายนั้น ๆ ได้ แต่ในบางครั้งโมเด็ลก็สามารถมั่นใจ (high confidence score) กับการทำนายของมันทั้ง ๆ ที่ทำนายผิดได้ ดังนั้น ต้องใช้ confidence score อย่างระมัดระวังเสมอ

- การนำผลหรือข้อมูลจาก AI ไปใช้งาน โดยไม่ผ่านการตรวจเช็ค (straight-through processing หรือ STP)

วิธีนี้จำเป็นต้องมีการเผื่อความเสียหายที่อาจเกิดขึ้นจากการทำงานที่ผิดพลาดเหล่านั้นอย่างเหมาะสม ตัวอย่างเช่น การแนะนำสินค้าที่ลูกค้าน่าจะถูกใจผิด ผลลบที่ได้คงเป็นเพียงการที่ลูกค้าไม่ซื้อของนั้น ๆ แต่ก็ยังอาจซื้อของอย่างอื่นต่อไปได้ ในกรณีนี้การทำปล่อยผลการทำนายเป็น STP สามารถทำได้

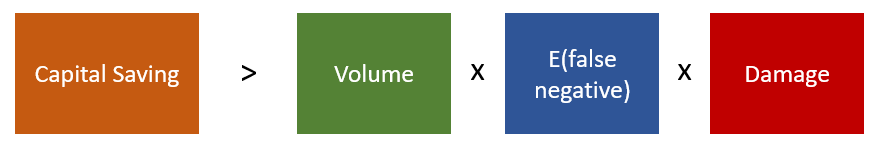

แต่ในอีกกรณีหนึ่ง เช่น การทำ loan auto-approval ของสถาบันการเงิน จากข้อมูล credit หรือ การทำ auto approval การส่งซ่อมรถ ของบริษัทประกันภัย หากปริมาณการเกิดขึ้นของกรณีดังกล่าวมากพอ บวกเข้ากับโอกาสในความผิดพลาดของ AI และความเสียหายในกรณีที่ปล่อยผ่านทำผิด ถ้าเทียบกันแล้วมีมูลค่าน้อยกว่าค่าใช้จ่ายแรงงานหรือมูลค่าเพิ่มที่แรงงานหรือ capital saving ดังกล่าวจะไปทำให้เกิดขึ้นได้ ก็อาจจะมีความเหมาะสมที่จะทำ STP โดยยอมให้ความผิดพลาดเหล่านั้นเกิดขึ้น หรือมีการวางตัวดักชั้นสองที่รับมือจัดการกับความผิดพลาดที่ออกไปสู่โลกภายนอกแล้วภายหลัง

Volume = ปริมาณการเกิดขึ้นของ class หนึ่งๆ ที่จะปล่อย STP

E(false negative) = Expected value of false negative = ความน่าจะเป็นที่ AI จะทำงานผิดและปล่อยผ่าน case นี้เป็น class อื่นทั้งที่ไม่ควรปล่อยDamage = มูลค่าความเสียหายในการปล่อยผ่าน เช่น หนี้ที่อาจจะสูญ หรือ ค่าซ่อมรถที่อาจไม่ควรต้องจ่าย

Damage = มูลค่าความเสียหายในการปล่อยผ่าน เช่น หนี้ที่อาจจะสูญ หรือ ค่าซ่อมรถที่อาจไม่ควรต้องจ่าย

- เพิ่ม threshold ของ AI confidence score

ในกรณีที่ไม่สามารถยอมรับความผิดพลาดได้ เช่น การวินิจฉัยโรคร้ายแรง ที่ถ้าปล่อยผ่านอาจมีอันตรายถึงชีวิต การทำ straight-through processing นั้นไม่ใช่สิ่งที่เหมาะสม เราสามารถตั้งค่า threshold ของ confidence score ของ AI โมเด็ลให้อยู่ในระดับที่เหมาะสมที่จะทำการ STP ได้บ้าง แต่ในขณะเดียวกัน ไม่ควรปล่อยผ่านตัวที่ไม่สามารถรับความเสียหายจากการตรวจจับไม่พบ แต่จากที่กล่าวไปก่อนหน้านี้ ผู้ใช้โมเด็ลต้องมีความแน่ใจว่า confidence score threshold นั้นใช้ได้จริง เนื่องจากบางครั้ง AI โมเด็ลบางตัวก็อาจให้ confidence score ที่สูงทั้งที่ผิดได้

3. AI เรียนรู้เพิ่มอยู่ตลอดเวลาและจะดีขึ้น ๆ ได้เองจนใกล้เคียง 100%

เราสามารถเทรน AI เพิ่มเติมได้จากข้อมูลที่เข้ามาใหม่ก็จริง แต่ในทางปฏิบัติแล้ว หายากที่โมเดล AI จะมีการทำการ re-training ใหม่เองโดยอัตโนมัติ ส่วนใหญ่ข้อมูลที่ได้รับมาจะถูกจัดเก็บไว้เพื่อนำไปเทรนในภายหลังด้วยเหตุผลดังนี้

- คนยังมีหน้าที่ตรวจสอบข้อมูลและสิ่งที่เป็นจริงก่อนจะนำไปเทรน

หากข้อมูลที่จะนำไปเทรนไม่ถูกต้อง เราก็จะได้โมเดล AI ที่ไม่ถูกต้องเช่นกัน ตามคำกล่าวที่ว่า “Garbage-in garbage-out”

- คนยังต้องตรวจเช็คผลว่าเมื่อเทรนใหม่แล้ว ได้ผลลัพธ์ดีขึ้นตามวัตถุประสงค์หรือไม่

การที่ AI ได้รับข้อมูลบางรูปแบบเท่านั้น อาจทำให้เกิด overfit หรือการเรียนรู้แบบผิด ๆ ขึ้นได้ รวมถึงอาจเกิด bias บางอย่างที่ไม่เป็นที่ยอมรับของสังคมได้เช่นกัน ยกตัวอย่างเช่น ลักษณะทางเชื้อชาติ สีผิว หรือ เพศ เป็นต้น ซึ่งหากปล่อยให้ AI ของเรา re-learn ด้วยตัวเอง อาจจะเกิดผลลัพธ์อันไม่พึงประสงค์ตามมา

ในกรณีที่เกิดการเรียนรู้แบบผิด ๆ หรือ bias ดังที่กล่าวมาแล้วข้างต้น แต่ต้องการให้ AI ทำการ re-train ตัวเองต่อไปก็สามารถทำได้ โดยมีข้อแม้ว่าการเรียนรู้ผิด ๆ ด้วยตัวเองของ AI นั้น จะต้องแทบจะไม่มีผล หรือ เกิดผลกระทบจาก bias น้อยมากเท่านั้น เราจึงจำเป็นต้องทำ re-training แบบ offline อยู่เสมอ ไม่ใช่ทำเมื่อมี data ใหม่เข้ามาเพียงอย่างเดียว

อย่างไรก็ตาม ในปัจจุบันการให้บริการ AI ในลักษณะ AI-as-a-service มีความแพร่หลายและสามารถช่วยแก้ปัญหานี้ได้ โดยข้อมูลที่ผู้ให้บริการด้าน AI ได้รับไปนั้น จะถูกจัดเก็บอย่างรวดเร็วและสะดวกต่อการนำไปเทรนใหม่ ส่งผลให้การเทรนเพิ่มเป็นสิ่งที่ทำได้ง่ายและรวดเร็วขึ้นเมื่อเทียบกับการทำ AI on-premise นอกเสียจากว่าผู้ใช้บริการเป็นผู้รับผิดชอบการพัฒนา AI นั้น ๆ เอง นอกจากนี้ การหมั่น feedback ว่า AI ทำสิ่งไหนถูกหรือผิดอยู่เสมอ ยังถือเป็นการช่วยพัฒนาความสามารถของ AI ให้ได้ผลลัพธ์ที่ดีขึ้นอีกด้วย

4. AI เมื่อเทรนจนดีเยี่ยมแล้ว ไม่จำเป็นต้องเทรนอีก

แม้ว่า AI จะทำงานได้ดีเยี่ยมจนเกือบ 100% ในการใช้งานปัจจุบัน แต่จะการละเลยการตรวจเช็คอย่างสม่ำเสมอไม่ได้ เพราะอาจเกิดสิ่งที่เรียกว่า model drift หรือ การที่ model ที่ใช้อยู่ ไม่ตรงกับสภาพการใช้งานในปัจจุบันอีกต่อไป ซึ่งเหตุการณ์นี้สามารถแยกเป็นกลุ่มใหญ่ ๆ ได้ 2 กลุ่ม ดังนี้

- Concept Drift

ความหมายของสิ่งที่บางอย่างที่เปลี่ยนไป ทำให้โมเด็ลใช้ไม่ได้อีกต่อไป เช่น การตรวจจับ fraud ถ้าความหมายของ fraud ใน business นั้น ๆ เปลี่ยนแปลง เราก็ไม่สามารถใช้โมเด็ลเดิมมาทำนาย fraud ได้อีกแล้ว

- Data Drift

ข้อมูลปัจจุบันไม่ตรงกับที่ใช้เทรนโมเด็ล ยกตัวอย่างเช่น รสนิยมของผู้บริโภคที่เปลี่ยนไปทำให้การ predict ความชอบในสินค้าใช้ได้ไม่ดีเหมือนเดิม วิธีแก้ปัญหานี้คือ ต้องคอยมีการตรวจเช็คการทำงานอยู่เสมอว่ายังคงผลเช่นเดิมอยู่หรือไม่

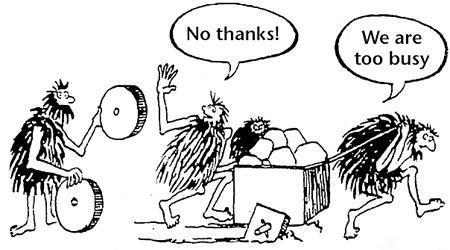

5. AI ต้องนำมาใช้แทนคนเพื่อลดต้นทุน

“AI ต้องมาแทนคน”

“ถ้า AI ทำงานได้ไม่ดีแล้วคนก็ต้องมาตรวจงาน AI เพิ่มความซ้ำซ้อน ทำงานยากกว่าเดิม”

“ถ้า AI ทำผิดแล้วจะยุ่งและเสียหาย”

ตามที่ได้กล่าวไปแล้วในหัวข้อก่อน ๆ ว่า AI ไม่สามารถทำงานได้แม่นยำ 100% ในทุกกรณี ดังนั้นการมี mindset แบบไบนารี่ตามข้อความข้างต้น จะทำให้ธุรกิจที่มี mindset ดังกล่าวพลาดโอกาสในการใช้ประโยชน์จาก AI อย่างเต็มประสิทธิภาพไปอย่างน่าเสียดาย

การวาง process ที่ดี โดยให้ AI ทำงานคู่กันกับมนุษย์ เพื่อลดเวลาและค่าใช้จ่าย 50% – 90% น่าจะเป็นเป้าหมายที่เป็นจริงและเหมาะสมกว่า หากเปรียบเทียบคงเหมือนกับเมื่อมนุษย์สร้างล้อขึ้นมาทำให้เคลื่อนย้ายของหรือคนได้อย่างรวดเร็วมากขึ้น หากเรามัวแต่คิดว่าล้อทำให้รถวิ่งเร็วเกินไป อันตราย แถมคนยังต้องคอยควบคุมพวงมาลัยอีก เราคงไม่มีรถใช้อย่างทุกวันนี้ ประโยชน์และความเสี่ยงของเทคโนโลยีใหม่มาด้วยกันเสมอขึ้นอยู่กับการใช้งาน

ส่งท้ายบทความ…

ความเข้าใจผิดในการนำ AI ไปใช้งานในภาคธุรกิจที่นำเสนอในบทความนี้พบเจอได้โดยทั่วไปในทุกภาคธุรกิจ ผู้เขียนหวังเป็นอย่างยิ่งว่าผู้อ่านจะหลีกเลี่ยงการใช้งาน AI อย่างผิดวิธี และ เข้าใจการใช้ประโยชน์ที่ถูกต้องจาก AI มากขึ้น โดยทำงานควบคู่ไปกับคนในองค์กรเพื่อให้ได้ประสิทธิภาพสูงสุด

ทีมงานผู้เชี่ยวชาญด้าน AI อัจฉริยะ พร้อมช่วยขับเคลื่อนการทำงานของธุรกิจ มีประสบการณ์ให้บริการโซลูชัน AI เพื่อองค์กรระดับประเทศมากมาย